- ▶ Management de l'entreprise ▶ Management Démocratique

- Conception de la stratégie

- Principes de gouvernance

- La Performance des métier

- Le contrôle de gestion

- ▶ Innover en équipe

- L'Innovation et la Performance

- L'Innovation Managériale

- La Méthode SOCRIDE

- ▶ Décider au quotidien

- Le processus de Décision

- La Décision en équipe

- Les Techniques de décision

- ▶ Guide gratuit de l'Autoformation

- Méthode d'autoformation

- Les 7 Qualités pour réussir

- Comment s'auto-évaluer ?

- ▶ Formation Gratuite Management

- Formation tableau de bord et BI

- Formation Management de Projet

- Formation Entrepreneuriat

- ▶ ebook et PDF management gratuits

- ▶ PDF Entrepreneuriat

- ▶ ebook Perfonomique

Business Intelligence, Architecture du SID

Les outils de la Business Intelligence

We are just beginning to understand how to use information as a tool. Peter Drucker

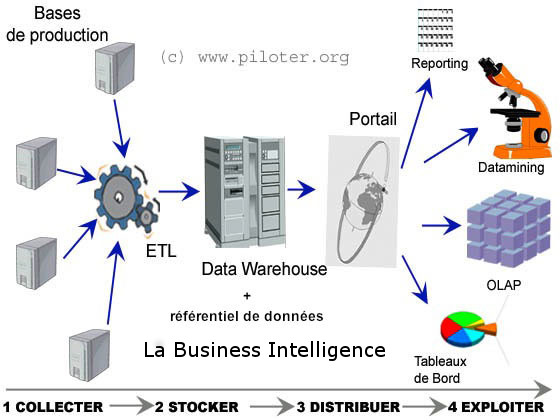

Architecture du Système d'Information Décisionnelle (SID)

La Business Intelligence (informatique décisionnelle) propose d'utiliser les données transitant par le Système d'information, données de production le plus souvent, en informations susceptibles d'être exploitées à des fins décisionnelles.Sur le plan pratique et technique, la Business Intelligence se compose d'une famille d'outils informatiques et de progiciels assurant le fonctionnement de la chaine de traitement de l'information.

Les 4 fonctions de la chaîne décisionnelle

Il est coutumier de présenter les éléments et outils composant la chaîne décisionnelle en quatre catégories correspondant chacune à une fonction spécifique, à une phase du processus.

Fig 1. Les 4 phases du processus de Business Intelligence, de la donnée à l'information.

- -1- Collecter, nettoyer et consolider les données Extraire les données des systèmes de production et les adapter à un usage décisionnel.

- -2- Stocker Centraliser les données structurées et traitées afin qu'elles soient disponibles pour un usage décisionnel.

- -3- Distribuer Ou plutôt faciliter l'accessibilité des informations selon les fonctions et les types d'utilisation.

- -4- Exploiter ou comment assister du mieux possible l'utilisateur afin qu'il puisse extraire la substance de l'information des données stockées à cet usage.

1. Collecter : Les outils d'ETL (Extract Transform and Load)

Collecter, Nettoyer et Consolider les données de l'entreprise étendue.

La collecte des données est une fonction remplie par une famille d'outils dénommée ETL pour Extract Transform load.

Le système d'information de l'entreprise ne s'est pas bâti en un temps unique. La majorité des systèmes d'information d'entreprise sont de nature hétérogène pour la plupart. Bien que la standardisation des échanges entre les divers outils informatiques avance à grands pas, la disparité des formats des données en circulation est toujours une réalité. C'est le principal obstacle technologique aux échanges étendus d'informations.

Avant d'être utilisables, les données seront formatées, nettoyées et consolidées. Les outils d'ETL (Extract Transform load) permettent d'automatiser ces traitements et de gérer les flux de données alimentant les bases de stockage : Data warehouse ou Datamart.

Le Master Data Management, la gestion des données de référence, assure la standardisation et la traçabilité des données de référence de l'entreprise. C'est un projet en soi dont la finalité dépasse la constitution de la base décisionnelle. La meilleure solution restant de mettre en oeuvre une gouvernance des données digne de ce nom. Ce sera le moyen de mieux garantir la qualité et la pertinence des données en fonction de l'usage que l'on en attend. Autrement, dit on ne peut décider qu'à la condition que les données utilisées soient toutes de confiance.

2. Stocker : Le Data warehouse et le datamart

Les bases de données de production ne sont pas utilisables pour une exploitation décisionnelle. Les données brutes ne sont pas prêtes à cet usage et par ailleurs les requêtes décisionnelles sont particulièrement gourmandes en ressources machines.Les données, au préalable nettoyées et consolidées, seront stockées dans une base spécialisée: le data warehouse ou le datamart.

Le datamart est une version plus réduite du data warehouse. Le data mart est orienté sujet ou thème et peut être par exemple utilisé pour des applications de CRM (Custom Relationship Management) ou de Data Mining .

Le data warehouse ou le datamart sont alimentés par l'outil d'ETL (Extract Transform load). À noter que le projet Data Warehouse est assez particulier. Il est préférable de le considérer comme un processus. Le Data Warehouse est en effet en perpétuelle évolution.

Formation en ligne

» Le Tableau de bord et la Business Intelligence

» Comment choisir le tableau de bord le plus en phase avec les besoins de l'entreprise

» Les analyses multidimensionnelles OLAP

» Comment choisir l'Outil décisionnel ? La table des critères pour sélectionner le bon produit

3. Distribuer les informations

L'écrasement de la pyramide et la multiplication des points de prise de décision modifient fondamentalement la gestion de l'information. L'information sera perçue en terme de flux et non d'unité de stockage. Afin de dynamiser la réactivité globale, l'information sera largement distribuée auprès de l'ensemble des partenaires. Aux premiers temps du web on attendait beaucoup du portail décisionnel, EIP Enterprise Information Portal, pour remplir cette fonction essentielle. Désormais, le développement du web a un peu modifier la donne avec une Business Intelligence de 2nde génération, exploitant pleinement les capacités du web social pour l'entreprise, démocratise très largement l'accès à l'information décisionnelle.4. Exploiter : Tableau de bord, analyse OLAP , datamining,...

Une fois les données stockées, nettoyées, consolidées et accessibles, elles sont utilisables. Selon les besoins, différents types d'outils d'extraction et d'exploitation seront envisagés.- Analyser les données, notamment avec les outils de type OLAP pour les analyses multidimensionnelles.

- Rechercher des corrélations peu visibles avec le Data mining .

- Piloter la performance, aide à la décision des décideurs en situation avec les tableaux de bord présentant les indicateurs clés de l'activité.

- Communiquer la performance avec le Reporting.

- Accéder à la connaissance, échanger avec ses pairs en exploitant pleinement les ressources coopératives du web social tel que le propose la Business Intelligence de deuxième génération.

Perspectives de la Business Intelligence

Les perspectives de la Business Intelligence...Principaux produits Open Source

Le projet Pentaho, Spago, Jaspersoft Business Intelligence Open Source

![]()

C'est en effet l'unique moyen de parvenir à une indispensable intelligence collective tout en répondant aux attentes des salariés qui pour la large majorité ne supporte plus d'être considéré comme un centre de coût, réduit "au mieux" à la portion congrue des succès.

Pourquoi oublie-t-on si facilement que ce sont eux les véritables créateurs de valeurs de l'entreprise ?

Dans cette étude, nous verrons comment bâtir concrètement avec exemples à l'appui une gouvernance coopérative digne de ce nom.

La transformation démocratique de l'entreprise

La transformation démocratique de l'entreprise

Pour en finir avec le mépris, principe délétère du management d'hier et d'aujourd'hui

Auteur : Alain Fernandez

Sujet : Une étude méthodique et illustrée d'implantation d'une gouvernance coopérative au sein d'une entreprise industrielle

Pages : 360 pages

ISBN : 978-2959320422

Dispo : Cliquez sur l'image

L’auteur

Alain Fernandez est un spécialiste de la mesure de la performance, de l’aide à la décision et de la conception de tableaux de bord de pilotage. Au fil de ces vingt dernières années, il a conduit de nombreux projets de réalisation de système décisionnel en France et à l'International. Il est l'auteur de plusieurs livres publiés aux Éditions Eyrolles consacrés à ce thème, vendus à plusieurs dizaines de milliers d'exemplaires et régulièrement réédités.

Alain Fernandez est un spécialiste de la mesure de la performance, de l’aide à la décision et de la conception de tableaux de bord de pilotage. Au fil de ces vingt dernières années, il a conduit de nombreux projets de réalisation de système décisionnel en France et à l'International. Il est l'auteur de plusieurs livres publiés aux Éditions Eyrolles consacrés à ce thème, vendus à plusieurs dizaines de milliers d'exemplaires et régulièrement réédités. À ce sujet, voir aussi

À ce sujet, voir aussi

Gouvernance des données de l'entreprise

Gouvernance des données de l'entreprise

L'importance de la gouvernance des données n'est plus à démontrer. Pour transformer les données en informations puis en connaissances, il est nécessaire d'investir dans la technologie. Les techniques, méthodes et outils d'ETL, Extract Transform Load remplissent cette fonction.Mais la technologie n'est pas suffisante pour régler la question. Collecter des données tous azimuts, sans une logique préalable, sans définir une stratégie spécifique peut s'avérer nettement moins profitable que prévu. Data Warehouse, Entrepôt de données

Data Warehouse, Entrepôt de données

Définition. Le Data Warehouse, est une base de données spécifique aux besoins décisionnels. Elle est intrinsèquement organisée de manière à assurer la stabilité contextuelle des données selon les sujets et thèmes de l'entreprise. Le data warehouse gère l'historisation des données structurées Data Mining, explorer les données du Data Warehouse

Data Mining, explorer les données du Data Warehouse

Il ne suffit pas de stocker une multitude de données au sein d'une base spécialisée, Data Warehouse ou Big Data, encore faut-il les exploiter. C'est là le rôle du Data Mining qui, bien utilisé, saura tirer les enseignements contenus dans cette masse de données bien trop importante pour se contenter des seuls outils statistiques. Voyons, le principe, les méthodes utilisées, les outils et un cas concret mettant en évidence l'importance de la qualité des données. Reporting Open Source

Reporting Open Source

Panorama des outils Reporting Open source : la Business Intelligence et le progiciel libre. Panorama des outils Reporting Open Source (OSS) Définition Reporting Open Source.

Les outils de reporting permettent de réaliser plus ou moins automatiquement des rapports d'activités. L'outil de reporting interroge les bases de données selon un schéma de requêtes SQL élaboré au préalable.

Les livres de référence

Les livres de référence

Cet ouvrage propose de dérouler un projet centré sur les utilisateurs, les managers décideurs, afin que la technologie soit à leur service et non l'inverse.

Les nouveaux tableaux de bord des managers

Les nouveaux tableaux de bord des managers

Le projet Business Intelligence en totalité

Alain Fernandez

Éditions Eyrolles 6ème édition

Disponible en librairie

›

www.amazon.fr

PDF & ePub

Kindle

![]() Voir ici la fiche technique, extraits, critiques...

Voir ici la fiche technique, extraits, critiques...

› Ralph Kimball, Margy Ross sont des experts très largement reconnus. L'approche pratique et très terrain dont ils sont coutumiers se retrouve à chacun des chapitres de cet ouvrage particulièrement complet.

The Data Warehouse Toolkit

The Data Warehouse Toolkit

The Definitive Guide to Dimensional Modeling

Ralph Kimball, Margy Ross,

John Wiley & Sons Ltd

Seconde édition révisée

600 pages (anglais)

Dispo :

› www.amazon.fr

Piloter l'Entreprise Innovante...

Piloter l'Entreprise Innovante...

De l'importance de réformer les principes archaïques de contrôle de la mesure de la performance pour enfin dynamiser la prise de décision en équipe, incontournable clé de l'entreprise innovante. La méthode SOCRIDE centrée sur les questions de Confiance et de Reconnaissance est ici expliquée, illustrée et détaillée :

Les tableaux de bord du manager innovant

Les tableaux de bord du manager innovant

Une démarche en 7 étapes pour faciliter la prise de décision en équipe

Alain Fernandez

Éditeur : Eyrolles

Pages : 320 pages

![]() Consultez la fiche technique »»»

Consultez la fiche technique »»»

Pour acheter ce livre :

Format ebook : PDF & ePub,

Format Kindle

Voir aussi...

Partagez cet article...

Partagez cet article...

(total partages cumulés > 105)

Pour approfondir

Un Bonheur Imaginaire

Décider en équipe

Tableau de bord DIY

Le système décisionnel

Bonnes pratiques projet

De salarié à entrepreneur

Astuces Entrepreneur

PDF Management

Les plus lus...

1. Business Intelligence Open Source, principe et produits

1. Business Intelligence Open Source, principe et produits2. La Business Intelligence au service du décideur, on n'impose pas des choix technologiques